《科创板日报》9月26日讯(编辑 宋子乔) 当地时间9月25日,谷歌DeepMind宣布其专为机器人设计的AI模型系列Gemini Robotics迎来重大更新,推出Gemini Robotics 1.5和Gemini Robotics-ER 1.5两款模型。这两款模型通过协同工作,构建了机器人的‘执行与决策系统’,标志着谷歌在机器人通用人工智能(AGI)领域迈出关键一步。

DeepMind团队表示:‘我们正在开启物理代理(physical agents)时代,让机器人能够感知环境、规划行动、使用工具并完成复杂的多步骤任务。新模型的发布是里程碑式成就,标志着我们在解决物理世界中的通用人工智能问题上取得了重要进展。’据介绍,搭载新模型的机器人可主动理解周围环境,并以通用方式完成复杂任务。

Gemini Robotics 1.5:视觉-语言-动作(VLA)模型的突破

作为谷歌目前性能最强的视觉-语言-动作模型,Gemini Robotics 1.5能够将视觉信息与指令转化为机器人的运动指令。该模型在执行任务前会进行‘思考’,并展示其推理过程,帮助机器人更精准地评估和完成复杂任务。此外,它支持动作迁移功能,即一个机器人学到的动作可被其他机器人复用,无需为每类机器人单独定制模型,显著提升了机器人的泛用性和学习效率。

Gemini Robotics-ER 1.5:物理环境中的规划与决策专家

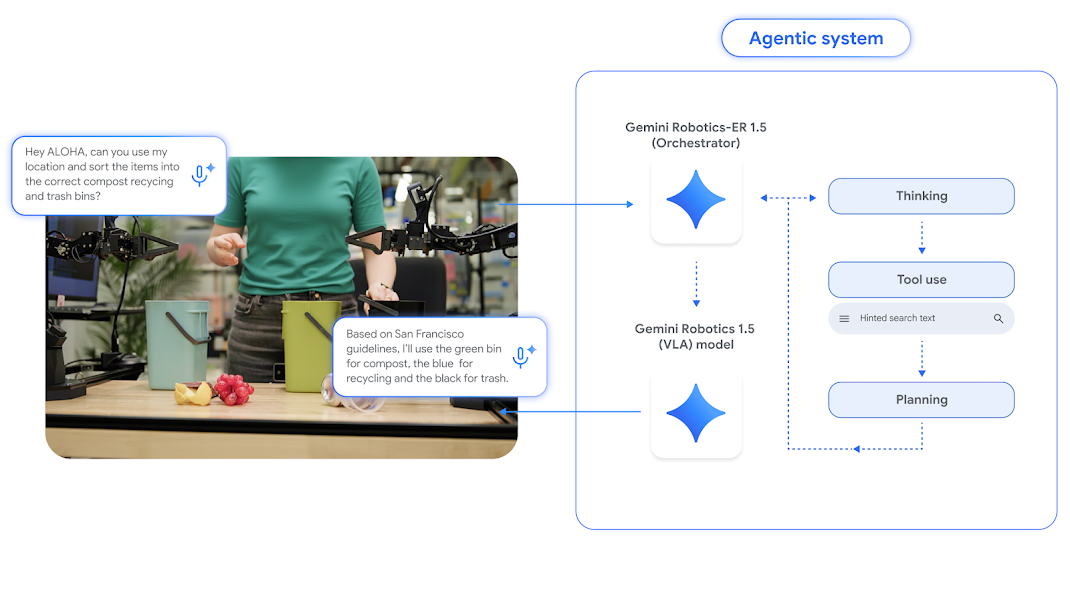

Gemini Robotics-ER 1.5是谷歌性能最强的视觉语言模型(VLM),擅长在物理环境中进行规划和逻辑决策。它具备先进的空间理解能力,可通过自然语言与用户交互,预估任务成功率和进度,并原生调用谷歌搜索等工具生成多步骤计划。例如,机器人可先通过该模型理解环境,再利用谷歌搜索查询信息,最后将结果转化为自然语言指令,由Gemini Robotics 1.5执行具体操作。

图:谷歌具身推理模型Gemini Robotics-ER 1.5与视觉-语言-动作模型Gemini Robotics 1.5协同执行复杂任务

谷歌的‘机器人安卓系统’战略

近年来,谷歌积极构建‘机器人界的Android系统’,通过提供强大的AI模型赋能不同机器人制造商,而非直接研发机器人本体。谷歌DeepMind机器人部门负责人卡罗琳娜·帕拉达(Carolina Parada)表示,其研发重点在于让机器人‘提前思考多个步骤’,这一理念与英伟达CEO黄仁勋提出的物理AI概念不谋而合。物理AI旨在让机器人感知并理解现实世界,从而与人交互并执行复杂任务。

科技巨头竞逐机器人AI模型赛道

AI模型作为机器人的‘大脑’,已成为行业核心竞争点。8月25日,英伟达推出专为物理AI和机器人设计的计算平台Jetson Thor,旨在成为科研与工业领域机器人系统的‘大脑’。与此同时,机器人初创公司Figure自主研发了端到端AI模型Helix,可将视觉语言模型的语义知识直接转化为动作;Dyna Robotics则通过环境数据输入让机器人自主学习,其CEO林登·高(Lindon Gao)表示:‘我们的目标是解锁物理AGI。’

行业趋势:自研AI模型打通AGI之路

中金公司研报指出,未来仅有少数具备全栈能力的机器人企业能突破至‘具身智能’层级。机器人大模型是破解传统控制瓶颈、迈向通用具身智能的关键路径。当前行业主要基于大语言模型、自动驾驶模型及多模态模型探索发展方向,产业重心已转向‘小脑+大脑’系统研发。华泰证券也认为,大模型决定了人形机器人的泛化能力天花板,是商业化的核心壁垒之一。随着谷歌、OpenAI、Meta、英伟达等科技大厂入局,以及华为、百度、科大讯飞等国内企业的跟进,行业将加速进入淘汰赛,不具备AI能力的本体厂商可能面临生存压力。